本文参考实战营提供的教程:Tutorial/docs/L1/OpenCompass/readme.md at camp3 · InternLM/Tutorial (github.com)

基础任务:

- 使用 OpenCompass 评测 internlm2-chat-1.8b 模型在 ceval 数据集上的性能

进阶任务:

- 使用 OpenCompass 进行主观评测

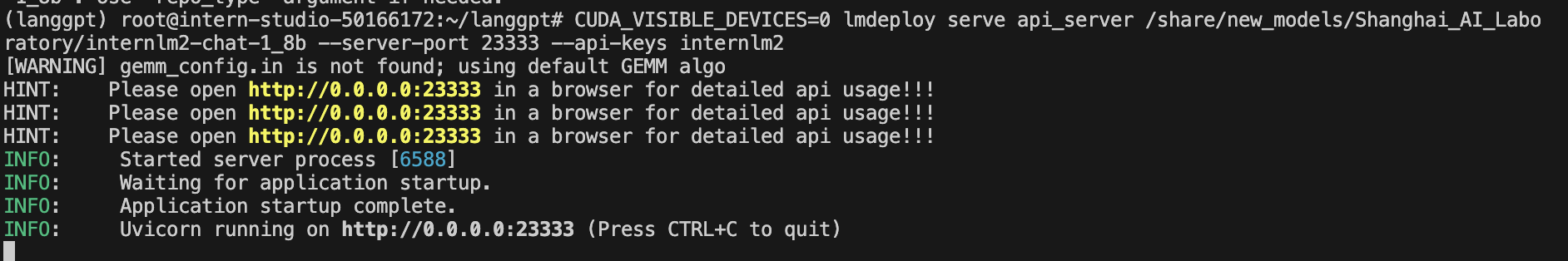

- 使用 OpenCompass 评测 InternLM2-Chat-1.8B 模型使用 LMDeploy部署后在 ceval 数据集上的性能

- 使用 OpenCompass 进行调用API评测

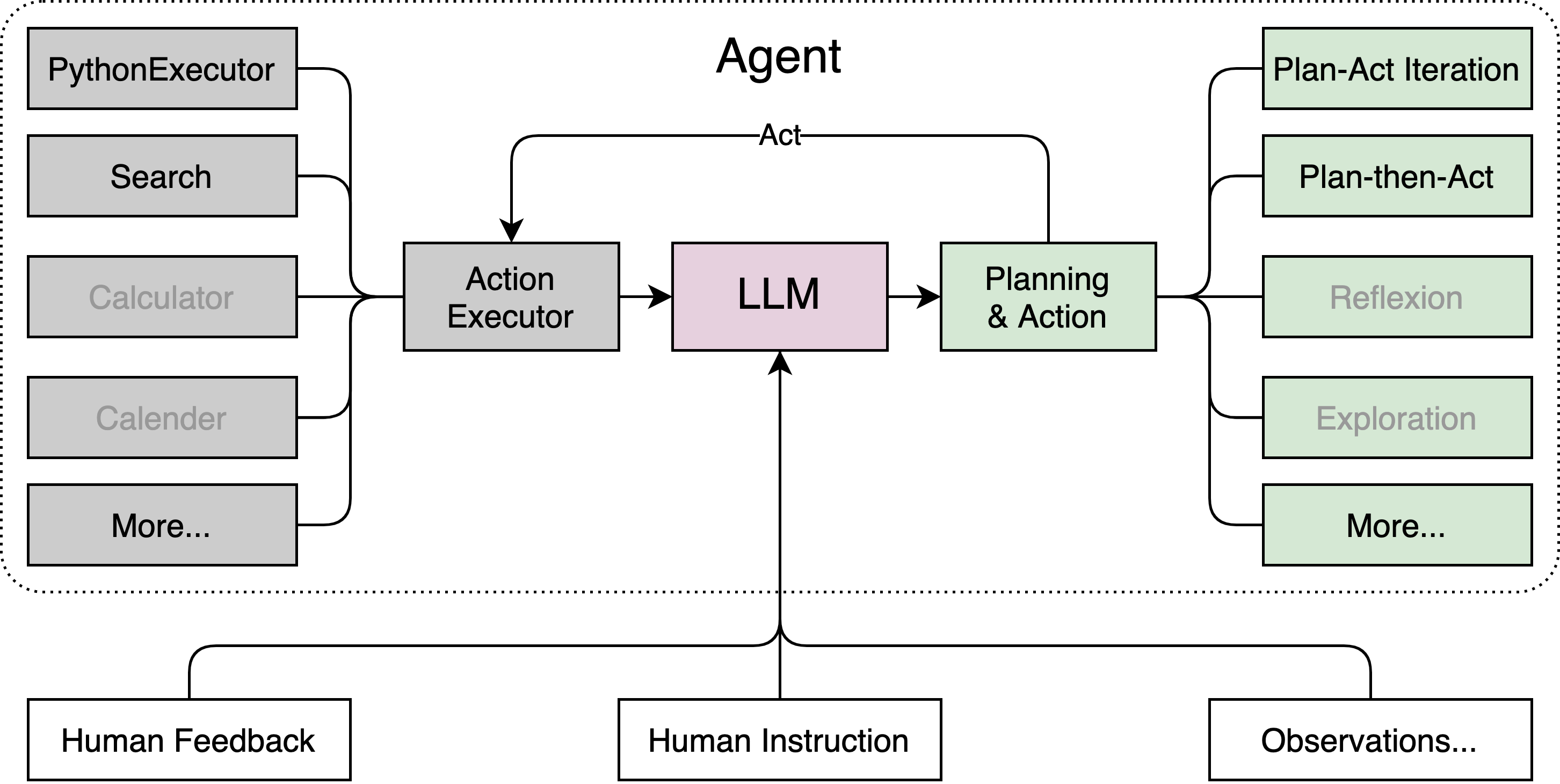

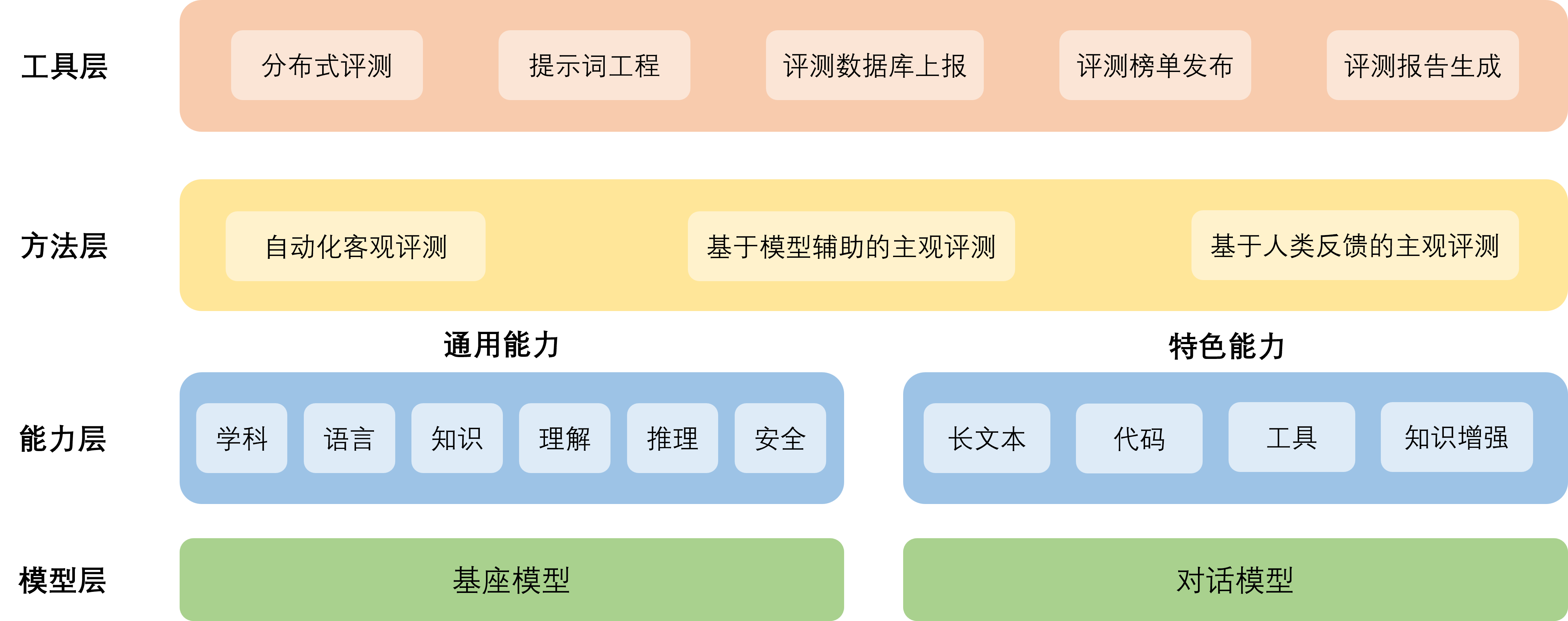

1 大模型评测

- 根据模型类型不同进行划分:比如基座模型与对话模型

- 根据模型问题是否有固定答案,划分为:客观问答题、客观选择题、开放式主观题(需要引入人类评测和模型评测两种方法)

- 长文本评测:例如检测模型是否会在长文本中途插入无关的语句

2 OpenCompass概览

OpenCompass评估一个模型通常包括以下几个阶段:配置 -> 推理 -> 评估 -> 可视化:

- 配置:这是整个工作流的起点。您需要配置整个评估过程,选择要评估的模型和数据集。此外,还可以选择评估策略、计算后端等,并定义显示结果的方式。

- 推理与评估:在这个阶段,OpenCompass 将会开始对模型和数据集进行并行推理和评估。推理阶段主要是让模型从数据集产生输出,而评估阶段则是衡量这些输出与标准答案的匹配程度。这两个过程会被拆分为多个同时运行的“任务”以提高效率。

- 可视化:评估完成后,OpenCompass 将结果整理成易读的表格,并将其保存为 CSV 和 TXT 文件。

3 环境配置

通过以下命令配置环境:

conda create -n opencompass python=3.10

conda activate opencompass

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

# 注意:一定要先 cd /root

cd /root

git clone -b 0.2.4 https://github.com/open-compass/opencompass

cd opencompass

pip install -e .

apt-get update

apt-get install cmake

pip install -r requirements.txt

pip install protobuf4 数据准备

4.1 评测数据集

首先我们需要评测数据集,由于使用的是InternStudio开发机,可以直接在share文件夹中获取:

cp /share/temp/datasets/OpenCompassData-core-20231110.zip /root/opencompass/unzip OpenCompassData-core-20231110.zip4.2 InternLM和ceval 相关的配置文件

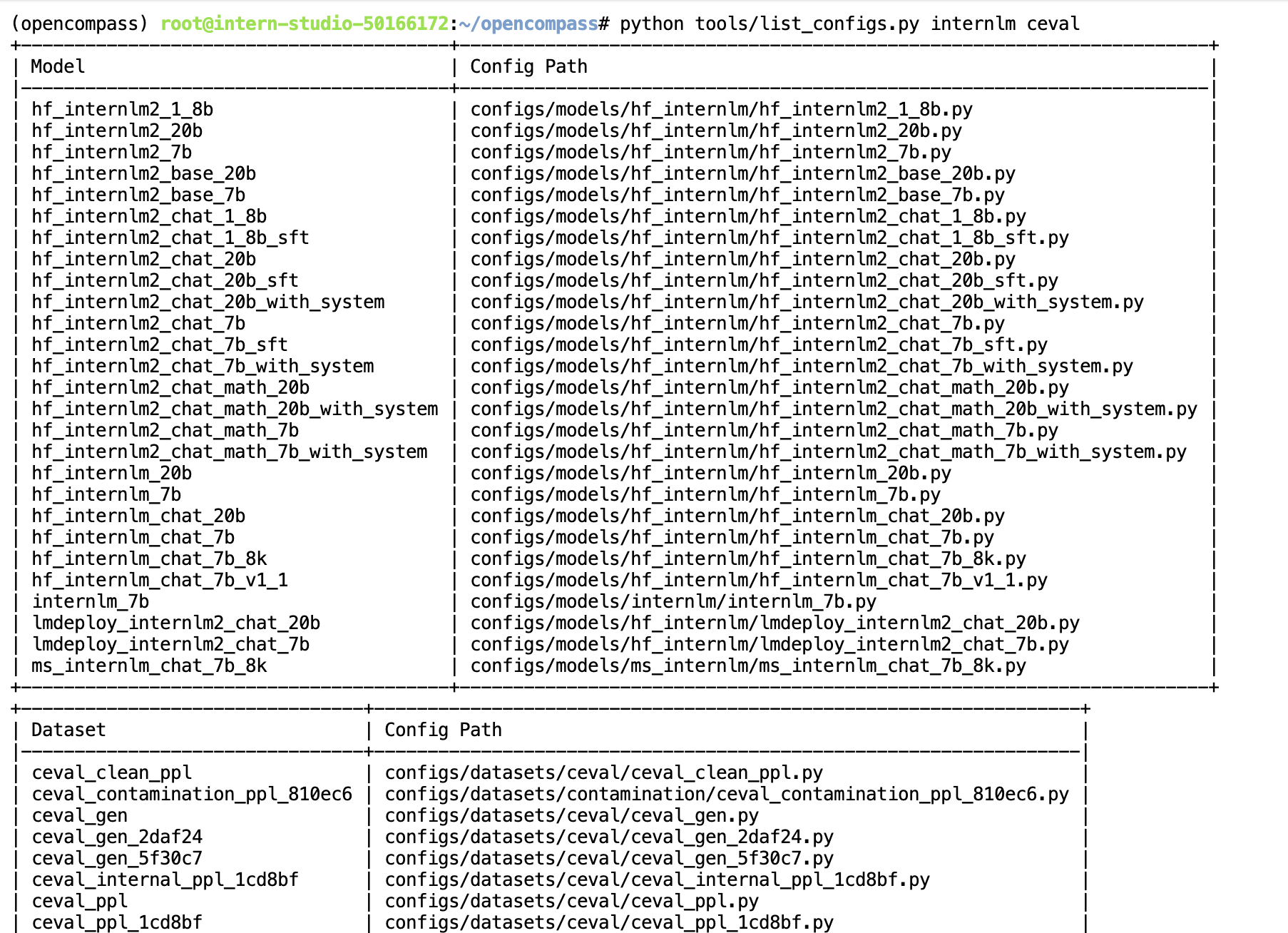

通过下面命令可以列出所有跟 InternLM 及 C-Eval 相关的配置:

python tools/list_configs.py internlm ceval运行结果如下所示:

5 开始评测

5.1 命令行评测

此节主要通过命令行评测internlm2-chat-1.8b 模型在 ceval 数据集上的性能

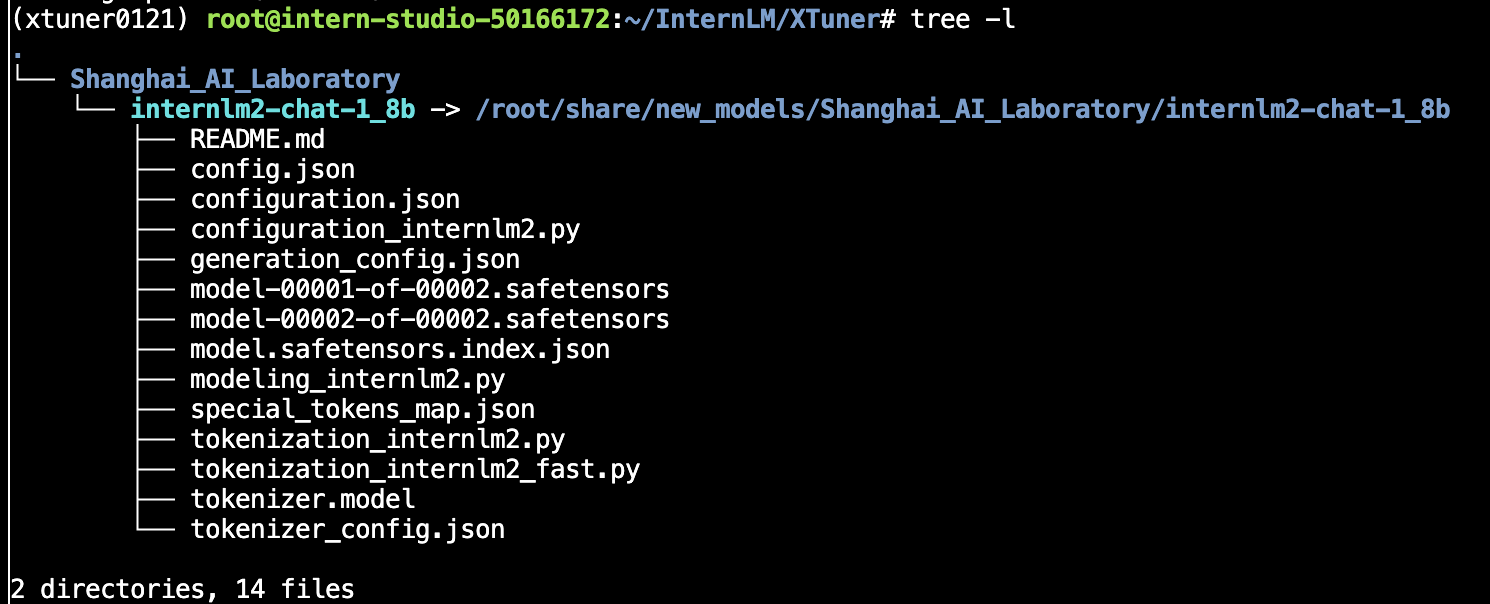

打开 opencompass文件夹下configs/models/hf_internlm/的hf_internlm2_chat_1_8b.py ,贴入以下代码:

from opencompass.models import HuggingFaceCausalLM

models = [

dict(

type=HuggingFaceCausalLM,

abbr='internlm2-1.8b-hf',

path="/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b",

tokenizer_path='/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b',

model_kwargs=dict(

trust_remote_code=True,

device_map='auto',

),

tokenizer_kwargs=dict(

padding_side='left',

truncation_side='left',

use_fast=False,

trust_remote_code=True,

),

max_out_len=100,

min_out_len=1,

max_seq_len=2048,

batch_size=8,

run_cfg=dict(num_gpus=1, num_procs=1),

)

]该段代码的作用是配置一个 Hugging Face 的因果语言模型,并提供了关于模型加载、分词器配置、输出长度、序列长度、批处理大小、以及运行时硬件配置的详细参数。

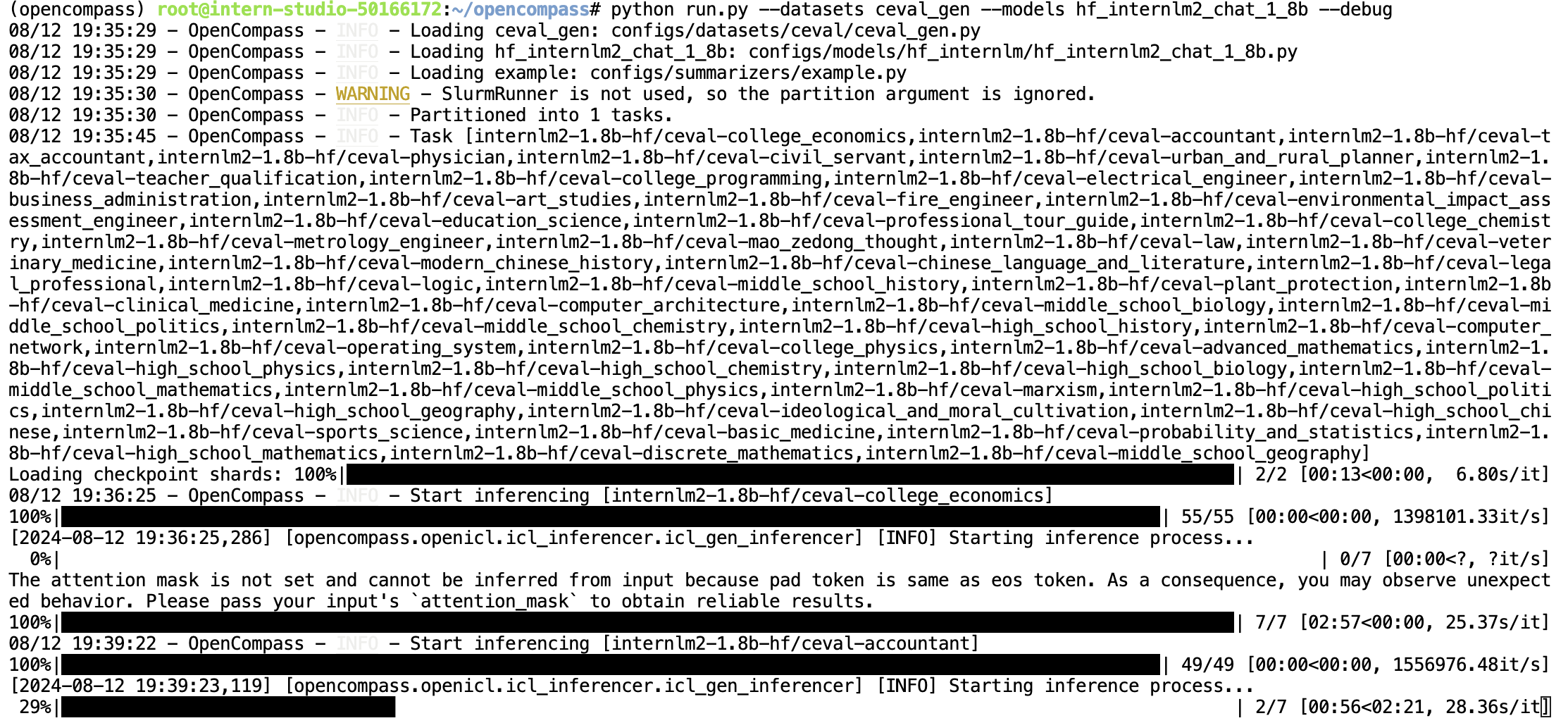

之后,我们可以通过以下命令评测 InternLM2-Chat-1.8B 模型在 C-Eval 数据集上的性能。在此之前我们需要先调整环境变量:

#环境变量配置

export MKL_SERVICE_FORCE_INTEL=1

export MKL_THREADING_LAYER=GNU由于 OpenCompass 默认并行启动评估过程,我们可以在第一次运行时以 –debug 模式启动评估,并检查是否存在问题。在 –debug 模式下,任务将按顺序执行,并实时打印输出。

python run.py --datasets ceval_gen --models hf_internlm2_chat_1_8b --debug运行时效果如下所示:

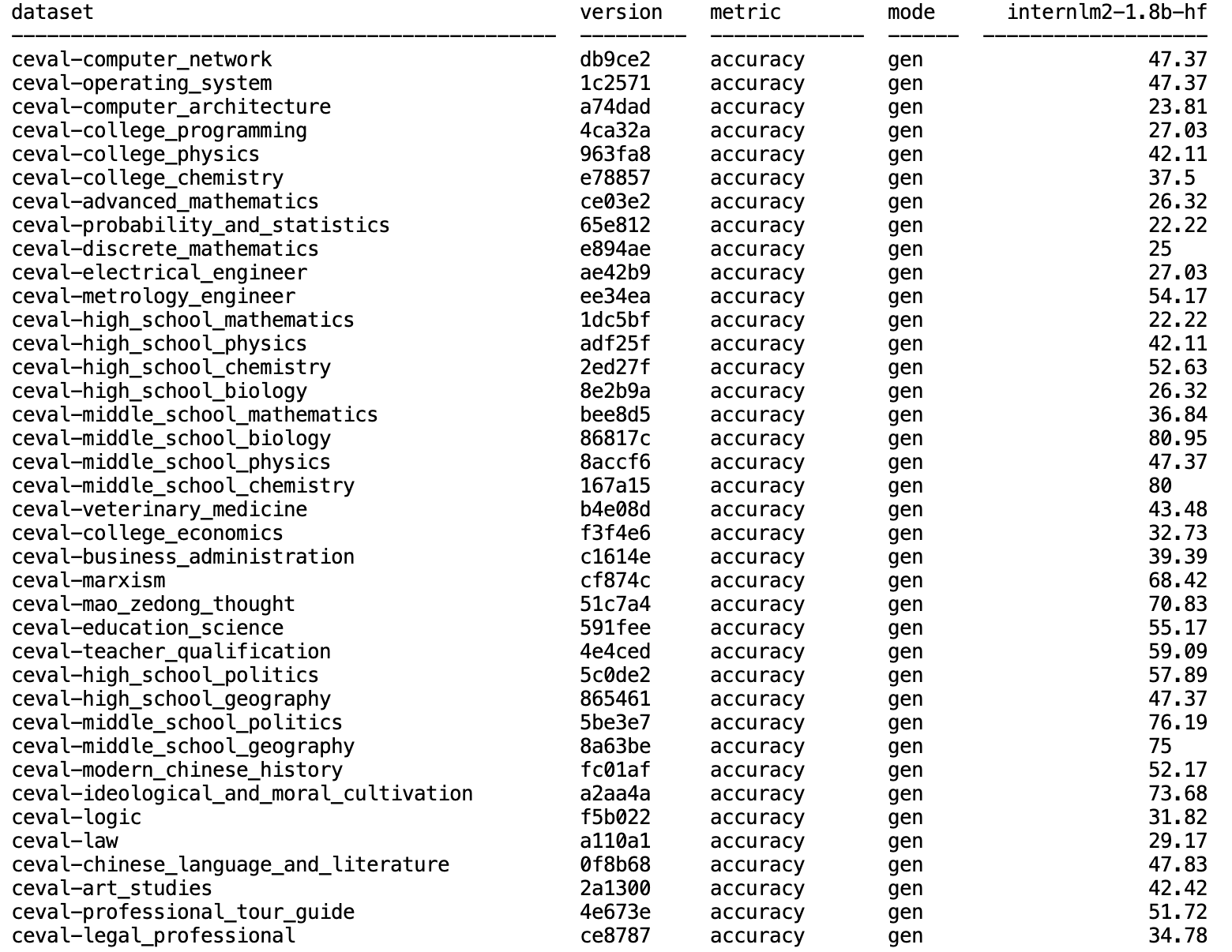

评测结果如下所示:

5.2 配置文件修改参数法进行评测

除了通过命令行配置实验外,OpenCompass 还允许用户在配置文件中编写实验的完整配置,并通过 run.py 直接运行它。配置文件是以 Python 格式组织的,并且必须包括 datasets 和 models 字段。本次测试配置在 configs文件夹 中。此配置通过 继承机制 引入所需的数据集和模型配置,并以所需格式组合 datasets 和 models 字段。 运行以下代码,在configs文件夹下创建eval_tutorial_demo.py

cd /root/opencompass/configstouch eval_tutorial_demo.py打开eval_tutorial_demo.py 贴入以下代码

from mmengine.config import read_base

with read_base():

from .datasets.ceval.ceval_gen import ceval_datasets

from .models.hf_internlm.hf_internlm2_chat_1_8b import models as hf_internlm2_chat_1_8b_models

datasets = ceval_datasets

models = hf_internlm2_chat_1_8b_models因此,运行任务时,我们只需将配置文件的路径传递给 run.py:

cd /root/opencompass

python run.py configs/eval_tutorial_demo.py --debug运行结果与上一节类似

5.3 进阶任务(待更新)

正在加紧完成中…