本文参考实战营提供的教程:Tutorial/docs/L1/Demo/readme.md at camp3 · InternLM/Tutorial (github.com)

本关卡主要需要完成的任务如下:

- InternLM2-Chat-1.8B 模型的部署(基础任务)

- InternLM-XComposer2-VL-1.8B 模型的部署(进阶任务)

- InternVL2-2B 模型的部署(进阶任务)

1.环境配置

首先我们需要创建一个开发机,配置如下:

创建完成后,我们需要创建一个可用的环境来运行我们的demo:

# 创建环境

conda create -n demo python=3.10 -y

# 激活环境

conda activate demo

# 安装 torch

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

# 安装其他依赖

pip install transformers==4.38

pip install sentencepiece==0.1.99

pip install einops==0.8.0

pip install protobuf==5.27.2

pip install accelerate==0.33.0

pip install streamlit==1.37.0

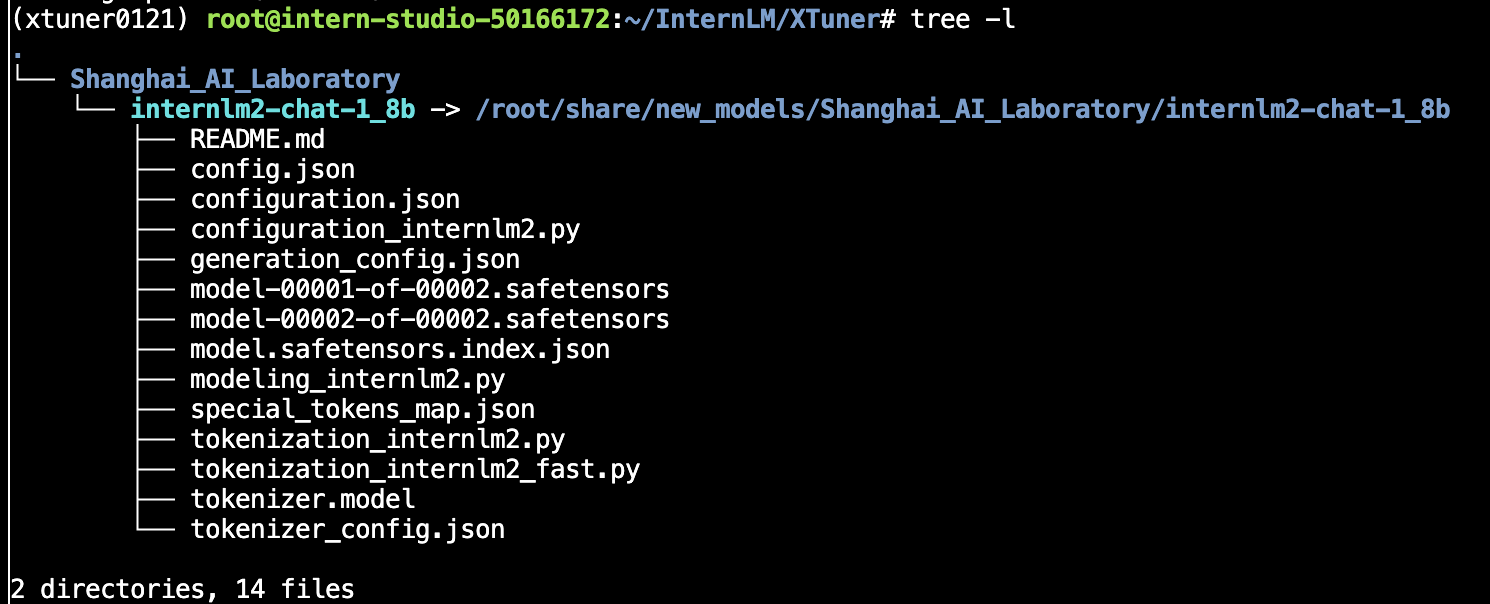

2.Cli Demo部署InternLM2-Chat-1.8B模型

首先我们创建一个任务用目录

mkdir -p /root/work/demo

touch /root/work/demo/cli_demo.py接下来我们通过编写代码加载InternLM模型,并实现一个简单的聊天机器人应用:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

# 定义模型路径

model_name_or_path = "/root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

# 加载模型和分词器

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

# 启动聊天循环

while True:

input_text = input("\nUser >>> ")

input_text = input_text.replace(' ', '')

if input_text == "exit":

break

length = 0

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

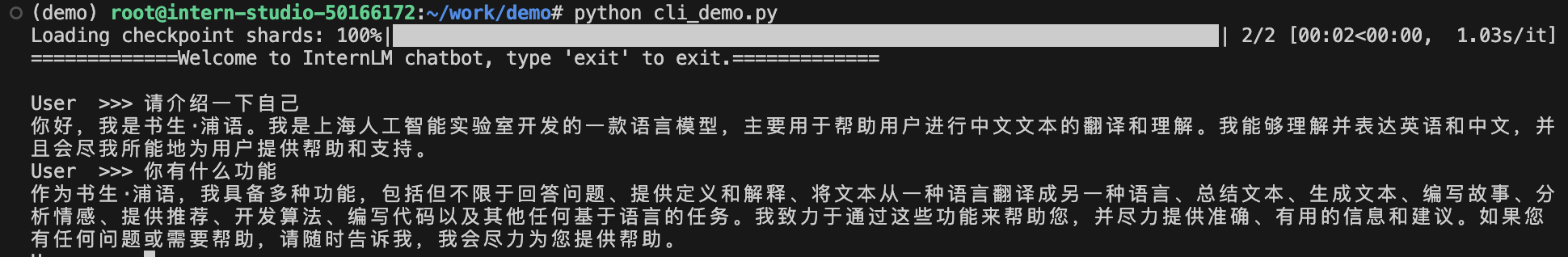

length = len(response)运行该代码,运行效果如下:

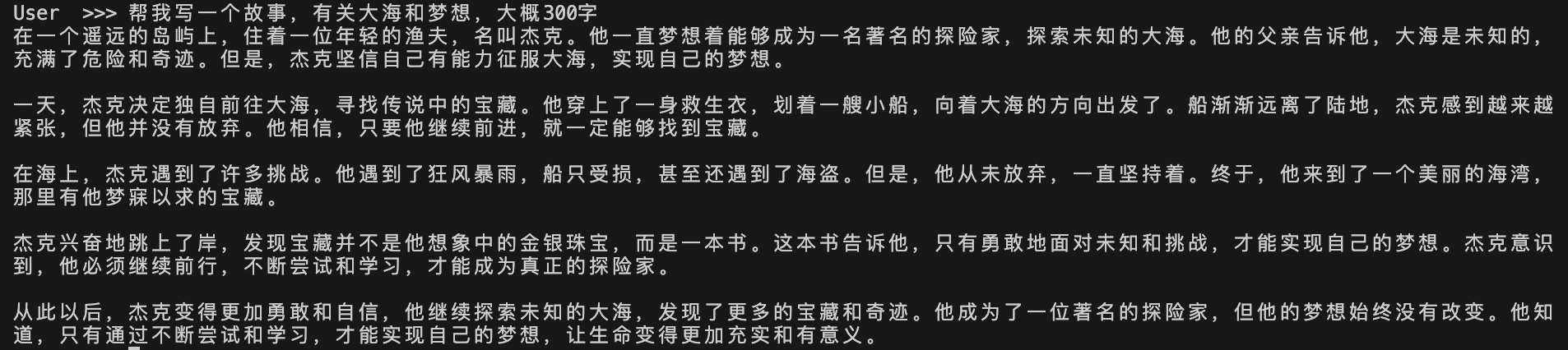

我们尝试用他生成一个有关大海和梦想的故事,运行结果如下:

3.LMDeploy 部署 InternLM-XComposer2-VL-1.8B 模型

在部署之前,我们先了解一下InternLM-XComposer2-VL-1.8B 模型和LMDeploy工具。

InternLM-XComposer2 是一款基于 InternLM2 的视觉语言大模型,其擅长自由形式的文本图像合成和理解。其主要特点包括:

- 自由形式的交错文本图像合成:InternLM-XComposer2 可以根据大纲、详细文本要求和参考图像等不同输入,生成连贯且上下文相关,具有交错图像和文本的文章,从而实现高度可定制的内容创建。

- 准确的视觉语言问题解决:InternLM-XComposer2 基于自由形式的指令准确地处理多样化和具有挑战性的视觉语言问答任务,在识别,感知,详细标签,视觉推理等方面表现出色。

- 令人惊叹的性能:基于 InternLM2-7B 的InternLM-XComposer2 在多个基准测试中位于开源多模态模型第一梯队,而且在部分基准测试中与 GPT-4V 和 Gemini Pro 相当甚至超过它们。

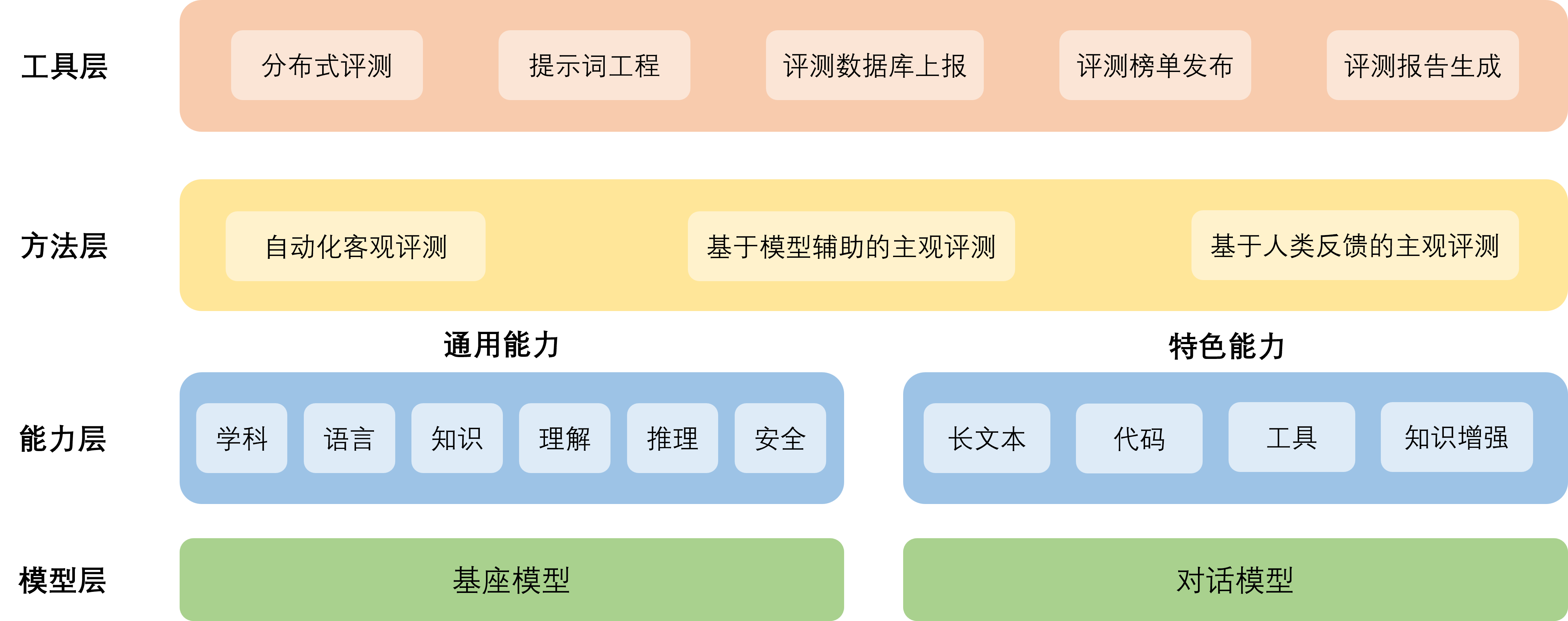

LMDeploy 是一个用于压缩、部署和服务 LLM 的工具包,由 MMRazor 和 MMDeploy 团队开发。它具有以下核心功能:

- 高效的推理:LMDeploy 通过引入持久化批处理、块 KV 缓存、动态分割与融合、张量并行、高性能 CUDA 内核等关键技术,提供了比 vLLM 高 1.8 倍的推理性能。

- 有效的量化:LMDeploy 支持仅权重量化和 k/v 量化,4bit 推理性能是 FP16 的 2.4 倍。量化后模型质量已通过 OpenCompass 评估确认。

- 轻松的分发:利用请求分发服务,LMDeploy 可以在多台机器和设备上轻松高效地部署多模型服务。

- 交互式推理模式:通过缓存多轮对话过程中注意力的 k/v,推理引擎记住对话历史,从而避免重复处理历史会话。

- 优秀的兼容性:LMDeploy支持 KV Cache Quant,AWQ 和自动前缀缓存同时使用。

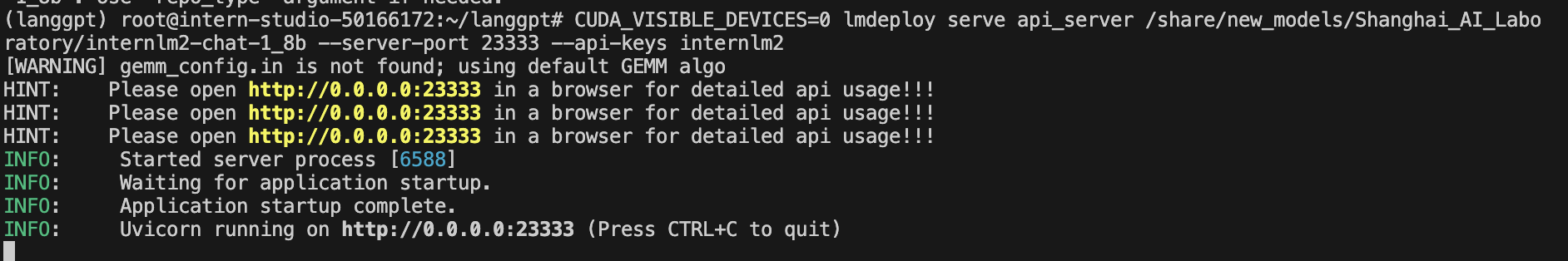

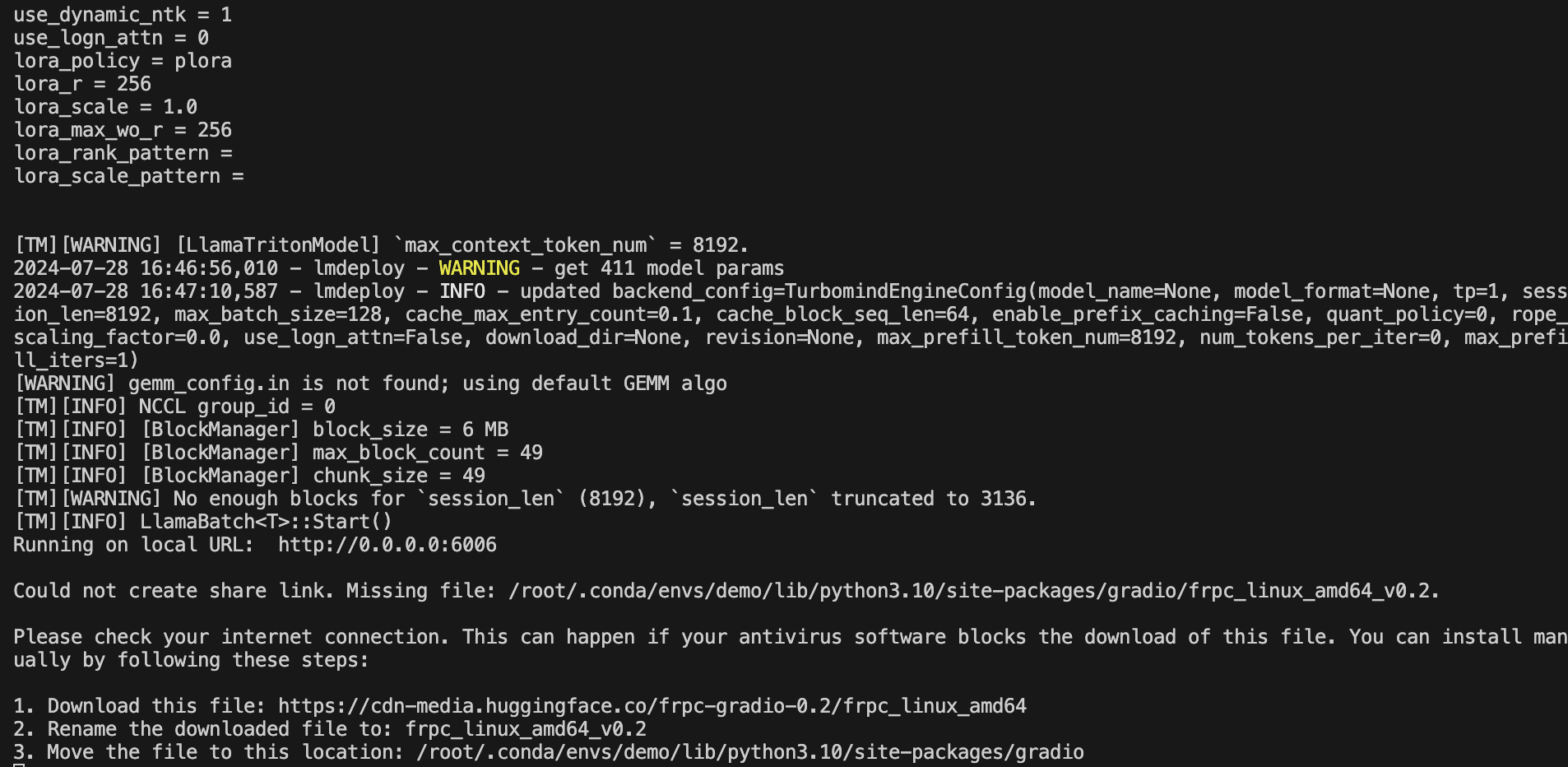

下面我们将尝试配置环境使用LMDeploy,完成InternLM-XComposer2-VL-1.8B模型的部署。首先需要配置相关的环境:

conda activate demo

pip install lmdeploy[all]==0.5.1

pip install timm==1.0.7接下来,可以通过LMDeploy启动一个与InternLM-XComposer2-VL-1.8B模型交互的Gradio服务。

Gradio是一个开源的Python库,它允许用户快速创建用户友好的Web界面,以便与机器学习模型和数据进行交互。

lmdeploy serve gradio /share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-1_8b --cache-max-entry-count 0.1运行命令后,终端如图所示:

同时,我们可以直接访问本地的6006端口,即可看到可视化界面:

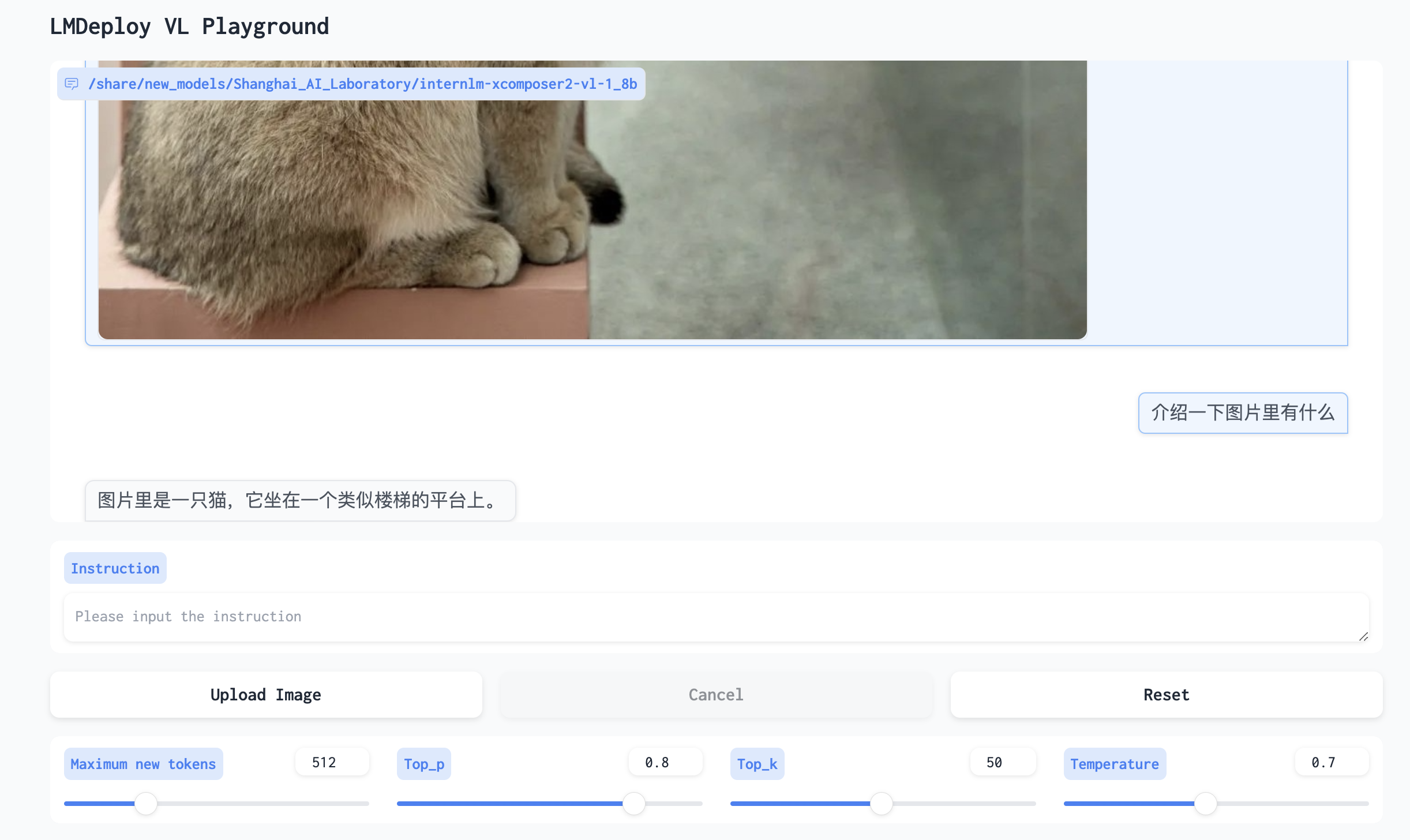

我们上传一张小猫的照片,并询问他图片里有什么:

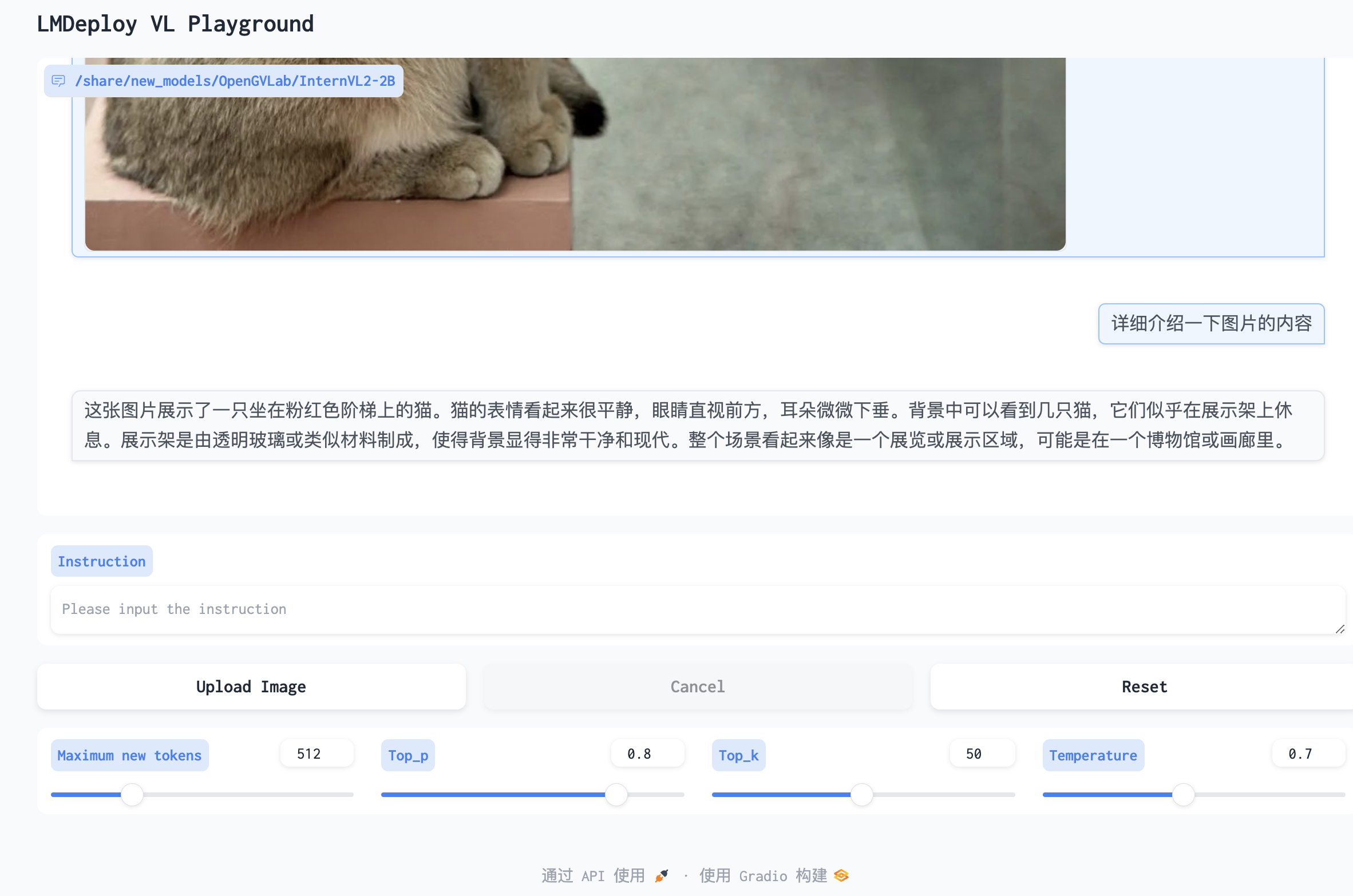

4.LMDeploy 部署 InternVL2-2B 模型

InternVL2 是上海人工智能实验室推出的新一代视觉-语言多模态大模型,是首个综合性能媲美国际闭源商业模型的开源多模态大模型。

同样的,我们可以通过LMDeploy启动一个与 InternVL2-2B模型交互的Gradio服务

lmdeploy serve gradio /share/new_models/OpenGVLab/InternVL2-2B --cache-max-entry-count 0.1